Apa itu Amazon SageMaker Model Training?

Pelatihan Model Amazon SageMaker mengurangi waktu dan biaya untuk melatih serta menyetel model machine learning (ML) dalam skala besar tanpa perlu mengelola infrastruktur. Anda dapat memanfaatkan infrastruktur komputasi ML beperforma tertinggi yang saat ini tersedia dan SageMaker dapat secara otomatis menaikkan atau menurunkan skala infrastruktur, dari satu hingga ribuan GPU. Karena hanya membayar untuk yang digunakan, Anda dapat mengelola biaya pelatihan dengan lebih efektif. Untuk melatih model deep learning lebih cepat, SageMaker membantu Anda memilih dan menyempurnakan set data secara waktu nyata. Pustaka pelatihan terdistribusi SageMaker dapat membagi model besar dan set data pelatihan secara otomatis di seluruh instans AWS GPU atau Anda dapat menggunakan pustaka pihak ketiga, seperti DeepSpeed, Horovod, atau Megatron. Latih model fondasi (FM) selama berminggu-minggu dan berbulan-bulan tanpa gangguan dengan memantau dan memperbaiki klaster pelatihan secara otomatis.

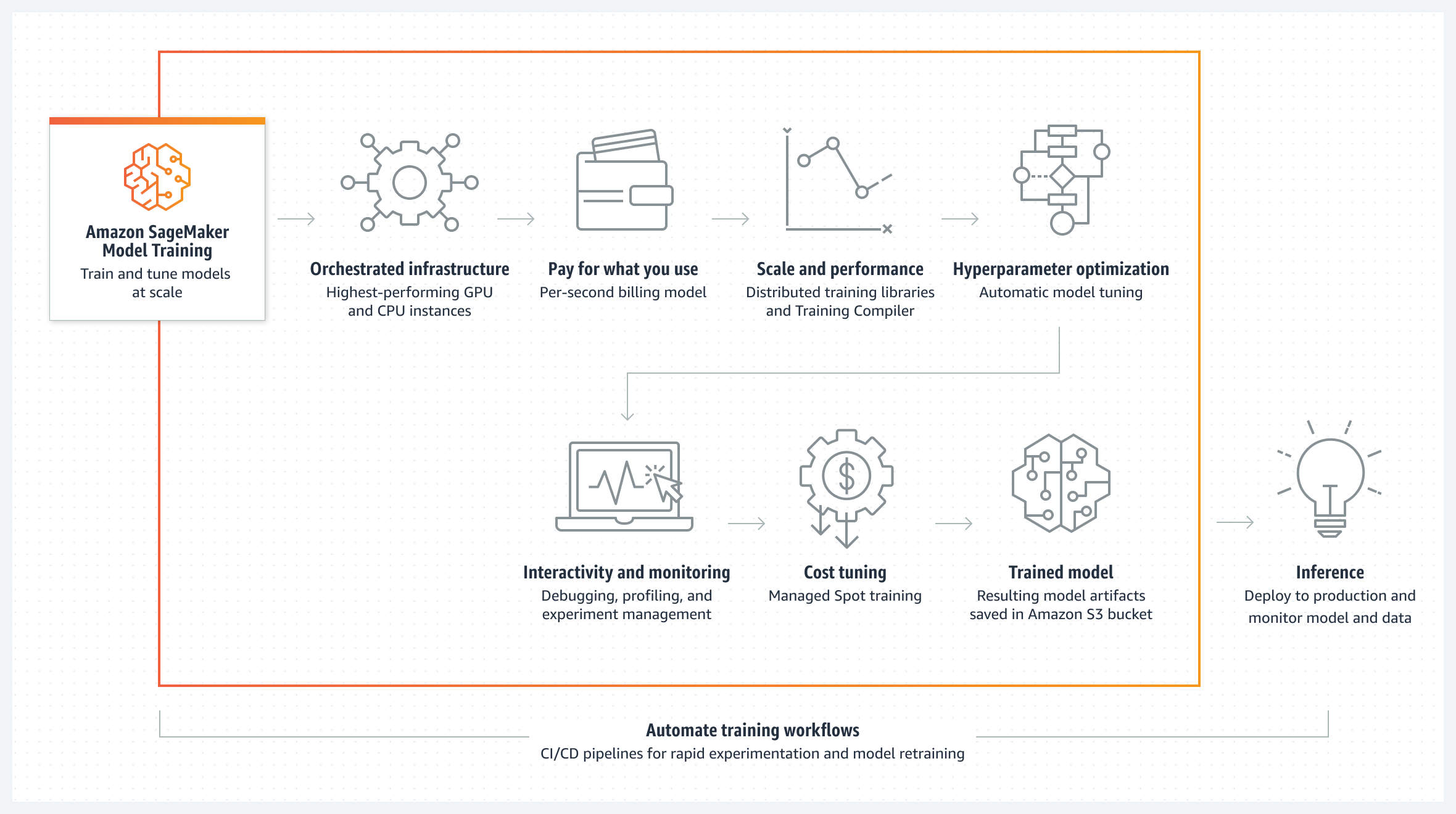

Cara kerja

Latih dan sesuaikan model ML dalam skala besar dengan alat ML canggih dan infrastruktur komputasi ML yang memiliki performa tertinggi.

Keuntungan pelatihan hemat biaya

Latih model dalam skala besar

Tugas pelatihan yang terkelola penuh

Tugas pelatihan Amazon SageMaker menawarkan pengalaman pengguna yang terkelola penuh untuk pelatihan FM terdistribusi berskala besar, yang menghilangkan pekerjaan berat yang tidak terdiferensiasi dalam pengelolaan infrastruktur. Tugas pelatihan SageMaker secara otomatis menjalankan klaster pelatihan terdistribusi yang tangguh, memantau infrastruktur, dan memulihkan secara otomatis dari kesalahan untuk memastikan pengalaman pelatihan yang lancar. Setelah pelatihan selesai, SageMaker menghentikan klaster dan Anda akan ditagih untuk waktu pelatihan bersih. Selain itu, dengan tugas pelatihan SageMaker, Anda memiliki fleksibilitas untuk memilih tipe instans yang tepat agar paling sesuai dengan beban kerja individu (misalnya, melatih LLM pada klaster P5 terlebih dahulu atau menyempurnakan LLM sumber terbuka pada instans p4d) untuk lebih mengoptimalkan anggaran pelatihan Anda. Selain itu, tugas pelatihan SageMaker menawarkan pengalaman pengguna yang konsisten di seluruh tim ML dengan berbagai tingkat keahlian teknis dan tipe beban kerja yang berbeda.

Amazon SageMaker HyperPod

Amazon SageMaker HyperPod adalah infrastruktur yang dibangun khusus untuk mengelola klaster komputasi secara efisien guna menskalakan pengembangan model fondasi (FM). Hal ini memungkinkan teknik pelatihan model lanjutan, kontrol infrastruktur, optimisasi performa, dan peningkatan observabilitas model. SageMaker HyperPod telah dikonfigurasi sebelumnya dengan pustaka pelatihan terdistribusi Amazon SageMaker, yang memungkinkan Anda membagi model dan set data pelatihan secara otomatis di seluruh instans klaster AWS guna membantu memanfaatkan infrastruktur komputasi dan jaringan klaster secara efisien. SageMaker HyperPod memungkinkan lingkungan yang lebih tangguh dengan mendeteksi, mendiagnosis, dan memulihkan dari kesalahan perangkat keras secara otomatis, yang memungkinkan Anda untuk terus melatih FM selama berbulan-bulan tanpa gangguan sehingga mengurangi waktu pelatihan hingga 40%.

Pelatihan terdistribusi performa tinggi

Dengan hanya beberapa baris kode, Anda dapat menambahkan paralelisme data atau paralelisme model ke skrip pelatihan Anda. SageMaker membuatnya lebih cepat untuk melakukan pelatihan terdistribusi dengan secara otomatis membagi model dan set data pelatihan Anda di seluruh instans AWS GPU.

Alat bawaan untuk akurasi tertinggi dan biaya terendah

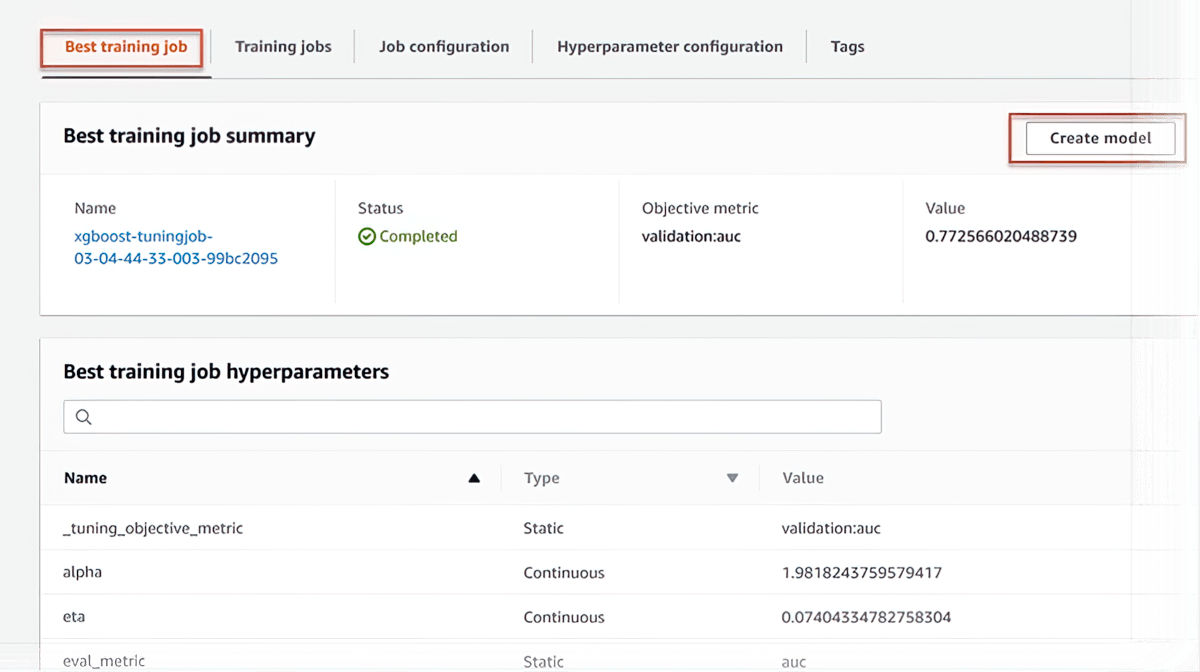

Penyetelan Model Otomatis

SageMaker dapat secara otomatis menyetel model Anda dengan menyesuaikan ribuan kombinasi parameter algoritma untuk sampai pada prediksi yang paling akurat, menghemat berminggu-minggu usaha. Hal ini membantu Anda menemukan versi model terbaik dengan menjalankan banyak tugas pelatihan pada set data Anda.

Pelatihan Spot Terkelola

SageMaker membantu mengurangi biaya pelatihan hingga 90 persen dengan secara otomatis menjalankan tugas pelatihan ketika kapasitas komputasi tersedia. Tugas pelatihan ini juga tahan terhadap gangguan yang disebabkan oleh perubahan kapasitas.

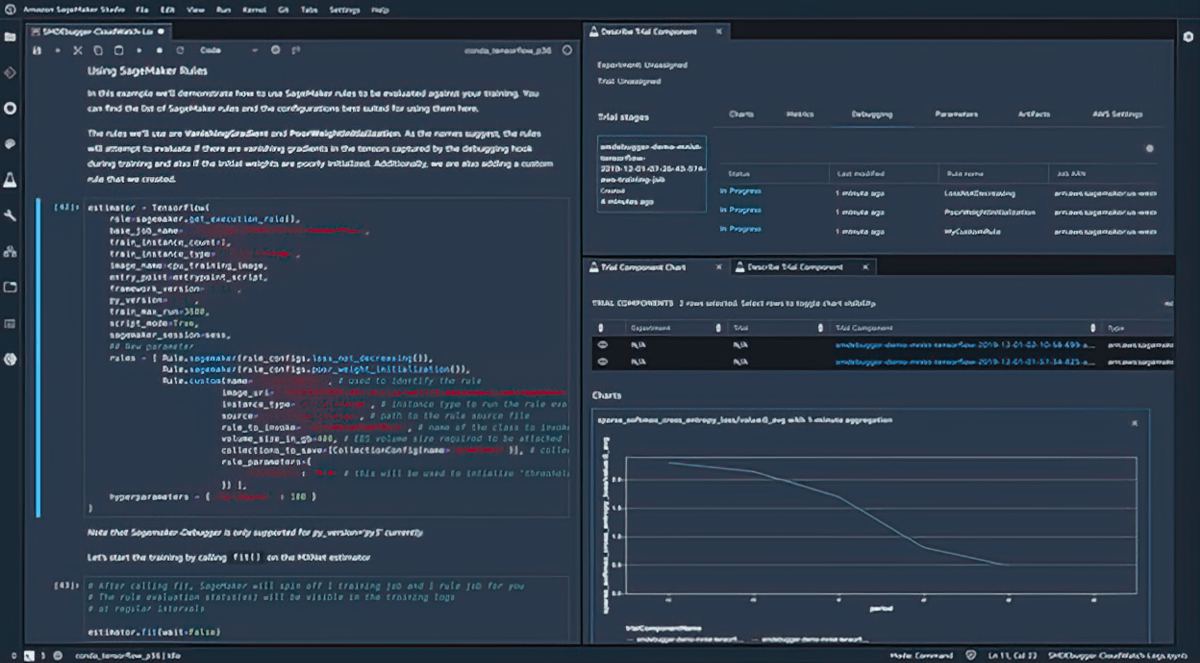

Debugging

Amazon SageMaker Debugger menangkap tugas pelatihan metrik dan profil secara waktu nyata sehingga Anda dapat dengan cepat memperbaiki masalah performa sebelum melakukan deployment model ke produksi. Anda juga dapat terhubung dari jarak jauh ke lingkungan pelatihan model di Amazon SageMaker untuk debugging dengan akses ke kontainer pelatihan dasar.

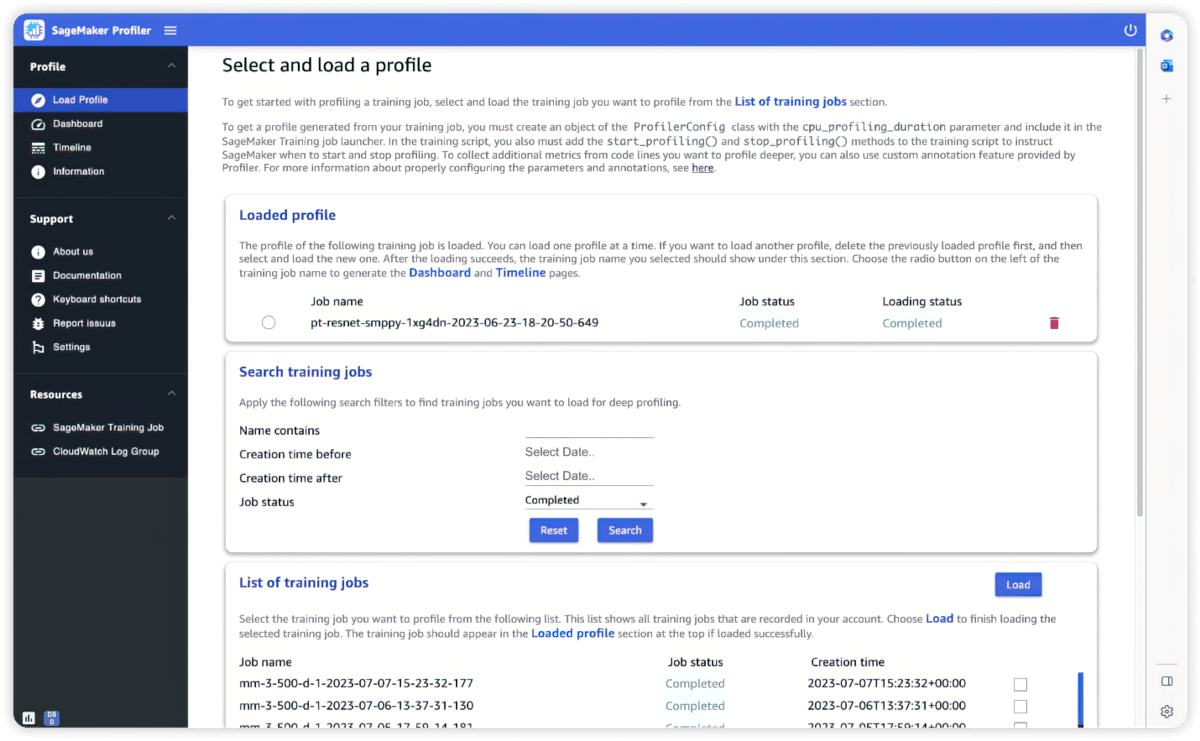

Profiler

Alat bawaan untuk interaktivitas dan pemantauan

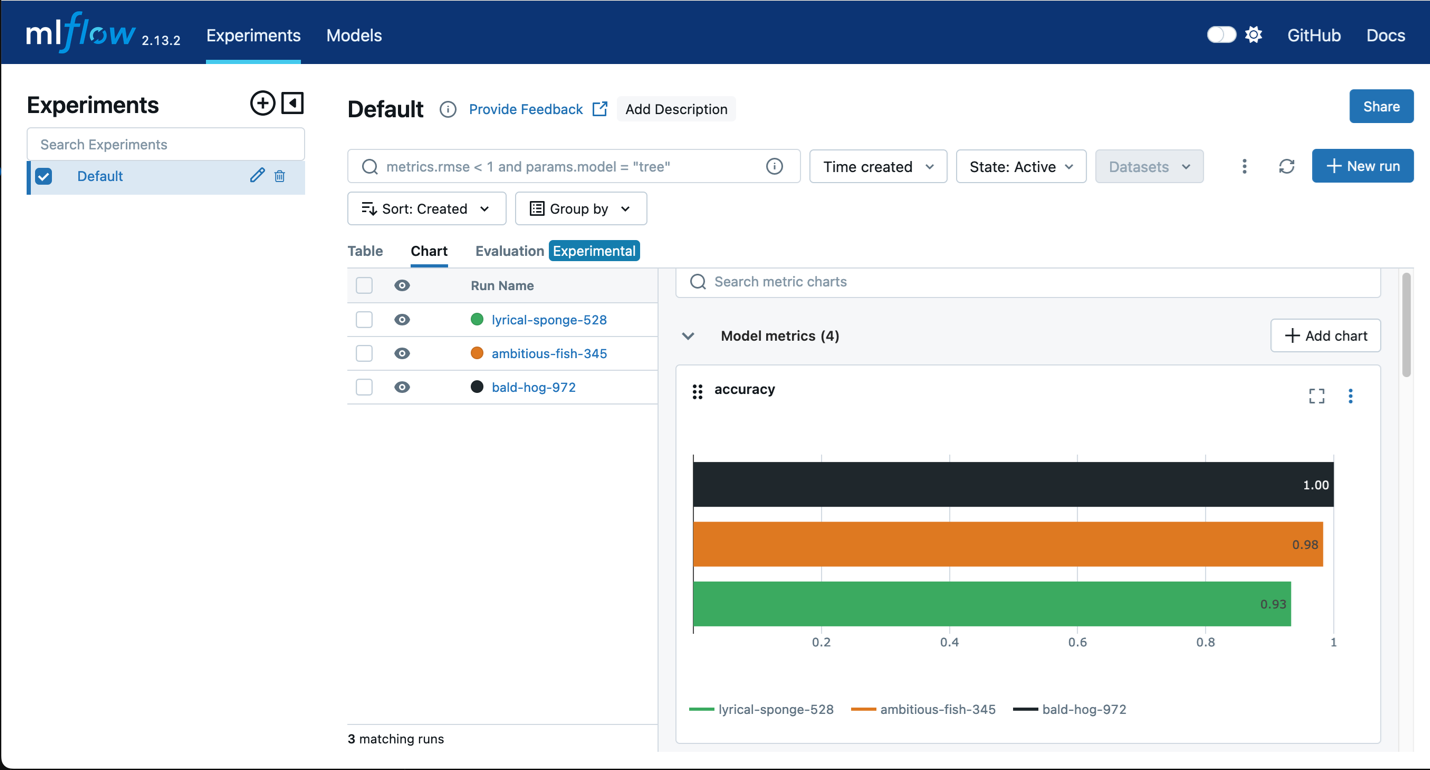

Amazon SageMaker dengan MLflow

Manfaatkan MLflow dengan pelatihan SageMaker untuk menangkap parameter, konfigurasi, dan hasil input, yang memungkinkan Anda mengidentifikasi model beperforma terbaik dengan cepat untuk kasus penggunaan Anda. UI MLflow memungkinkan Anda menganalisis upaya pelatihan model dan mendaftarkan model kandidat dengan mudah untuk produksi dengan satu kali klik.

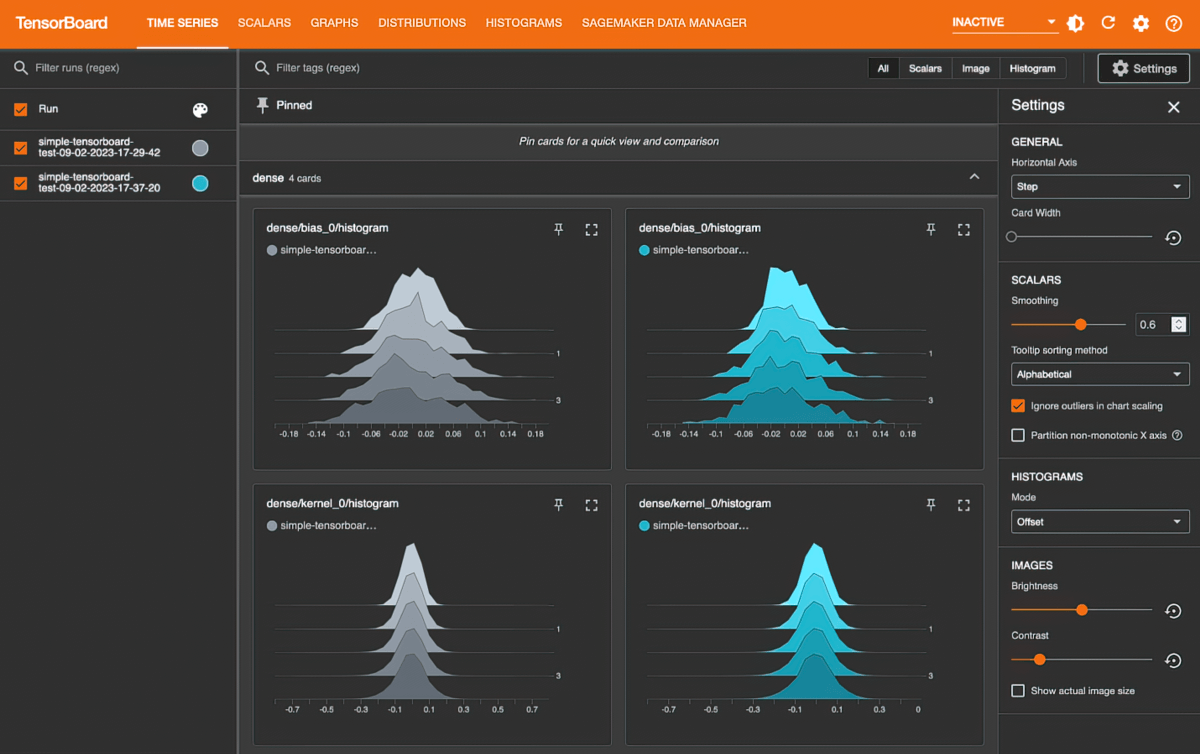

Amazon SageMaker dengan TensorBoard

Amazon SageMaker dengan TensorBoard membantu Anda menghemat waktu pengembangan dengan memvisualisasikan arsitektur model untuk mengidentifikasi dan memulihkan masalah konvergensi, seperti kehilangan validasi yang tidak konvergen atau menghilangnya gradien.